Société

Attaque au couteau à Cannes-La Bocca : deux blessés, un individu retranché

Un impressionnant déploiement de forces de l'ordre et de secours est en cours ce dimanche à Cannes-La Bocca après une attaque au couteau. Deux blessés sont à déplorer, et un individu serait retranché.

Culture

Kieslowski en 1994 : « Dans la vie comme dans mes films, j’ai besoin de l’humour »

Dans un entretien de 1994, Krzysztof Kieslowski évoque « Trois Couleurs : Rouge », son humour et sa retraite annoncée, deux ans avant sa mort.

Sport

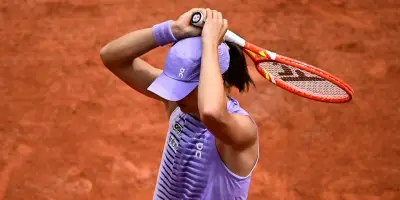

Roland-Garros 2026 : Iga Swiatek, quadruple lauréate, éliminée en quarts

Iga Swiatek, quadruple vainqueure de Roland-Garros, a été battue en quarts de finale par une adversaire inattendue, mettant fin à son règne sur la terre battue parisienne.

International

Guerre au Moyen-Orient : la France condamne l'avancée israélienne au Liban

La France estime qu'Israël a commis une faute majeure en avançant sur le territoire libanais et demande une réunion d'urgence du Conseil de sécurité de l'ONU.

Politique

Économie

Orient Express Corinthian : le plus grand voilier du monde à Saint-Tropez

Le plus grand voilier du monde, l'Orient Express Corinthian, a choisi Saint-Tropez comme port d'attache. Cinq escales sont prévues pour ce yacht de 220 mètres, estimé à un demi-milliard d'euros.

Orient Express Corinthian : escale à Villefranche-sur-Mer

Le plus grand voilier du monde, l'Orient Express Corinthian, a fait une escale remarquée à Villefranche-sur-Mer ce dimanche 31 mai, après son passage à Cannes pendant le Festival.

Duralex : l'angoisse des salariés près d'Orléans

À La Chapelle-Saint-Mesmin, les employés de Duralex vivent dans l'incertitude face à des difficultés économiques persistantes. La direction annonce des mesures drastiques.

Stationnement gratuit 1h à Cagnes-sur-Mer dès juin 2026

À partir du 1er juin 2026, Cagnes-sur-Mer modifie ses règles de stationnement : 1h gratuite, tolérance de 15 min, nouvelles zones payantes.

Indemnité carburant : 439 000 demandes déjà enregistrées

Près de 440 000 automobilistes ont sollicité l'aide aux grands rouleurs. Les premiers versements de 100 euros sont attendus en juin. Attention aux fausses déclarations.

Environnement

Restez informé

Abonnez-vous à notre newsletter pour recevoir les dernières actualités directement dans votre boîte mail !

Nous n'envoyons jamais de spam