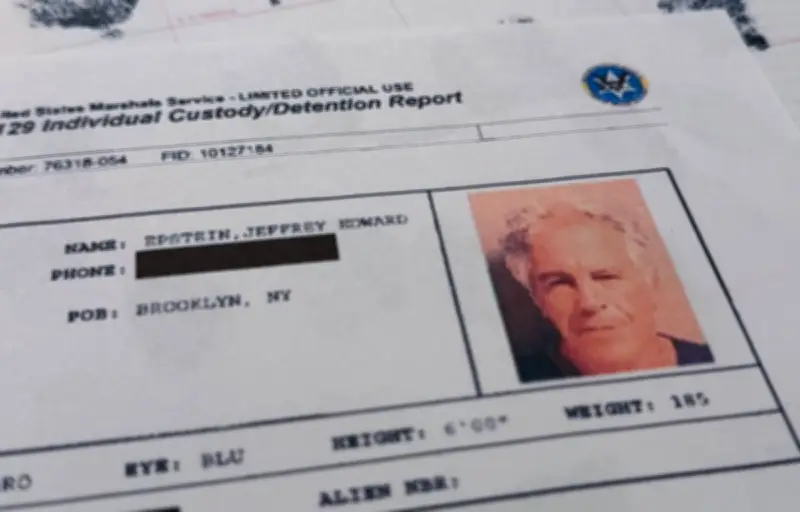

Une image virale de Jeffrey Epstein révélée comme un deepfake généré par IA

Comment atteindre 7,3 millions de vues sur la plateforme X ? En ressuscitant artificiellement les morts. C'est précisément la stratégie employée par un post viral qui prétendait exhiber une photographie récente de Jeffrey Epstein, le financier américain décédé en 2019. Cette image, partagée massivement, montrait Epstein dans un cadre suggérant sa présence actuelle en Israël, avec des panneaux en hébreu visibles en arrière-plan.

La révélation du logo Gemini

La vérification de cette photographie ne nécessite pas d'enquête approfondie. En examinant attentivement l'image originale, un détail crucial apparaît dans le coin inférieur droit : une petite astroïde, reconnaissable comme le logo officiel de Gemini, l'intelligence artificielle générative développée par Google. Cette marque distinctive trahit immédiatement l'origine artificielle du contenu.

Que ce hoax résulte d'une maladresse évidente – il aurait suffi de recadrer l'image pour masquer le logo, comme l'a fait l'auteur du post viral – ou d'une confession tacite, le créateur de ce deepfake n'a manifestement déployé aucun effort pour dissimuler sa supercherie. Le post accompagnant l'image posait explicitement la question : « Jeffrey Epstein est-il toujours vivant ? C'est de l'IA. », tout en propageant simultanément la théorie complotiste.

Une tradition ancienne de fausses résurrections

Les théories du complot affirmant qu'une personnalité célèbre aurait simulé sa mort ne constituent pas un phénomène nouveau. Elles remontent à des siècles, bien au-delà des légendes entourant Adolf Hitler. Dès le premier siècle de notre ère, l'empereur romain Néron faisait déjà l'objet de récits similaires après sa mort présumée. Cette persistance historique montre comment les récits de fausses morts continuent de captiver l'imagination collective à travers les époques.

Le démenti des vérificateurs de faits

Ce contenu trompeur a été systématiquement démystifié par plusieurs organisations de vérification des faits, dont l'Agence France-Presse (AFP), Leadstories, Politifact et Newschecker. Ces institutions s'accordent unanimement pour affirmer qu'aucun élément tangible ne vient étayer le récit propagé par ces publications virales. Leur analyse collective confirme que l'image est un produit de l'intelligence artificielle, sans aucun fondement dans la réalité.

Cette affaire illustre comment les deepfakes générés par IA peuvent rapidement atteindre une audience massive sur les réseaux sociaux, exploitant la fascination pour les théories du complot entourant les figures controversées. Elle souligne également l'importance cruciale de la vérification des sources et de l'éducation aux médias dans l'ère numérique actuelle.