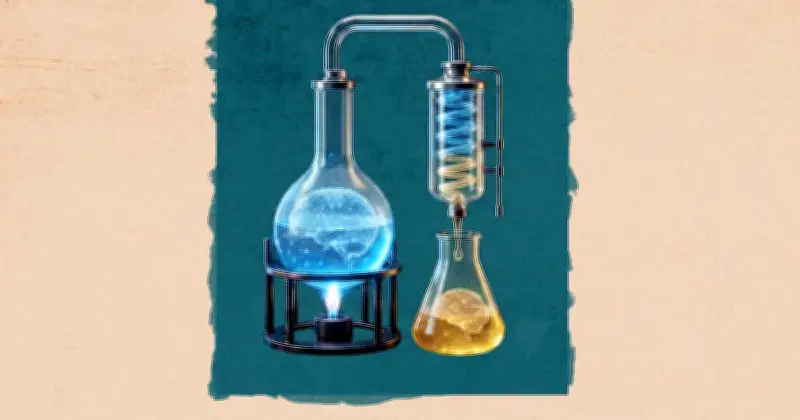

La technique est aussi ancienne que la civilisation. Des premiers parfums en Mésopotamie jusqu’aux whiskys écossais et raffineurs de pétroles modernes, la distillation est l'art d'extraire l’essentiel d’une matière. Dans certains cas même, ce qu’elle a de plus précieux. Surprise : cela s’applique également à l’immatérielle intelligence artificielle. Bien entendu, ici, nul besoin de faire chauffer quoi que ce soit avec un alambic.

Qu'est-ce que la distillation en IA ?

"La distillation est un transfert de connaissances d'un modèle d'IA vers un autre. On génère des données avec un grand modèle (le 'modèle enseignant') et on entraîne un modèle plus petit à imiter ses réponses", résume Loubna Ben Allal, ingénieure au sein de l’entreprise franco-américaine Hugging Face. L’objectif est d'obtenir un modèle moins coûteux à faire tourner, qui conserve l'essentiel des capacités de son aîné.

Une pratique courante mais controversée

Tout le monde l’emploie. "La distillation est une méthode d'entraînement largement utilisée et légitime", écrit Anthropic, l’un des leaders du marché. L’utilisation de données dites synthétiques, qui ne sont pas directement issues de vrais corpus de texte, est ainsi devenue monnaie courante dans le secteur. Le problème, déplore le créateur de l’agent conversationnel Claude, c’est que la distillation de l’IA peut s’apparenter à de la triche quand elle est réalisée sur ses modèles… par ses concurrents.

Des accusations contre des rivaux chinois

Anthropic a récemment mis en cause trois rivaux, tous basés en Chine : le désormais célèbre DeepSeek, et les moins connus MiniMax et Moonshot. L’Américain a dénoncé l’utilisation, sur sa plateforme, de "16 millions d’échanges avec Claude" à partir d’environ "24 000 comptes frauduleux", afin de le copier.