Les IA génératives prises en défaut par des questions absurdes

Ces dernières semaines, une tendance amusante a circulé sur internet : des utilisateurs ont testé ChatGPT et d'autres assistants IA avec des questions délibérément incohérentes. L'une d'elles demandait s'il était préférable d'aller à une station de lavage automobile ou à une station-service à pied ou en voiture. Certaines intelligences artificielles ont défendu avec conviction l'option la plus sobre, sans saisir l'absurdité fondamentale de la question.

Le "bullshit bench" : un comparateur révélateur

Des experts en intelligence artificielle ont récemment créé un benchmark spécifique, surnommé le "bullshit bench", pour évaluer comment différents modèles d'IA gèrent les questions dépourvues de sens. Les résultats montrent des performances variables selon les acteurs. Anthropic, avec son modèle Claude, s'en sort plutôt bien, tandis que ChatGPT, Mistral et DeepSeek rencontrent davantage de difficultés à identifier le non-sens.

Le fonctionnement fondamental des LLM en question

Ce phénomène met en lumière une limite structurelle des modèles de langage actuels. Les IA génératives fonctionnent en construisant leurs réponses mot à mot, basées sur des associations statistiques apprises à partir de milliards de données textuelles. Lorsqu'on soumet à ChatGPT la phrase "je laisse tomber un vase en cristal", il répond que le vase se brise non pas parce qu'il comprend les lois de la physique, mais parce que cette association est extrêmement fréquente dans son corpus d'entraînement.

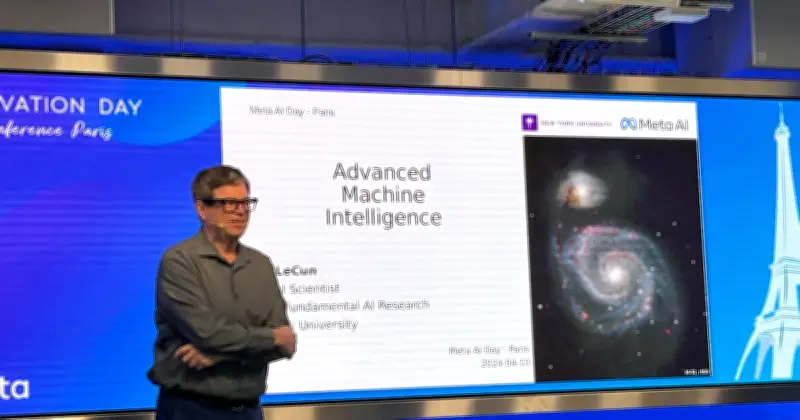

Yann Le Cun et la quête de modèles plus intelligents

Le célèbre chercheur français Yann Le Cun, lauréat du prix Turing et ancien responsable scientifique chez Meta, identifie cette limitation comme un "plafond de verre" empêchant les IA actuelles de comprendre des phénomènes simples du monde réel. Cette semaine, il a officialisé une levée de fonds record d'environ un milliard de dollars pour sa nouvelle entreprise AMI Labs, avec l'ambition de développer ce qu'il appelle des "World Models" (modèles du monde).

Contrairement aux modèles de langage actuels qui apprennent principalement à partir de données textuelles, ces nouvelles IA disposeraient d'une véritable représentation des objets et de leurs propriétés physiques. Par exemple, elles ne se contenteraient pas d'associer le mot "chat" à des descriptions textuelles, mais comprendraient sa forme, ses mouvements, et sa capacité à retomber sur ses pattes.

Yann Le Cun a d'ailleurs affirmé de manière provocante que "l'IA générative est 50 fois moins intelligente qu'un enfant de 4 ans", ajoutant qu'elle serait même moins intelligente qu'un chat domestique. Cette déclaration souligne l'écart entre les capacités actuelles des IA et l'intelligence du monde vivant, même sous ses formes les plus élémentaires.

Le développement des "World Models" représente donc une tentative de combler cet écart en dotant les intelligences artificielles d'une compréhension plus profonde et plus intuitive du monde qui les entoure, au-delà des simples associations statistiques entre mots.