L'IA militaire et la dilution progressive des responsabilités

L'essor rapide de l'intelligence artificielle dans les applications militaires suscite des inquiétudes croissantes parmi les experts en éthique et en sécurité. Contrairement aux armes traditionnelles, où la chaîne de commandement et la responsabilité humaine sont clairement définies, l'IA introduit une complexité nouvelle qui pourrait progressivement diluer l'imputabilité des décisions de combat.

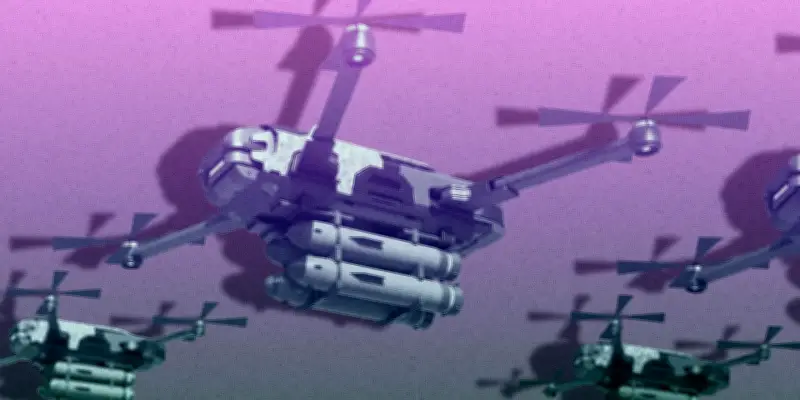

Une transformation profonde des opérations militaires

Les systèmes d'IA sont de plus en plus intégrés dans des domaines critiques tels que la reconnaissance de cibles, la logistique, et même la prise de décisions tactiques. Cette automatisation, bien qu'elle promette une efficacité accrue, soulève des questions fondamentales sur le contrôle humain. Qui est responsable lorsqu'un algorithme commet une erreur fatale ? La réponse n'est pas simple, car la responsabilité peut être dispersée entre les développeurs, les opérateurs, et les commandants militaires.

Cette dilution progressive des responsabilités n'est pas un phénomène nouveau, mais l'IA l'amplifie de manière significative. Dans les conflits modernes, où les systèmes autonomes peuvent agir à des vitesses dépassant la capacité humaine de réaction, le risque d'erreurs irréversibles augmente. Les décisions prises en quelques millisecondes par une machine peuvent avoir des conséquences humanitaires désastreuses, sans qu'un individu unique puisse être tenu pour pleinement responsable.

Les défis éthiques et juridiques

Sur le plan éthique, l'utilisation de l'IA militaire remet en cause les principes fondamentaux du droit international humanitaire, tels que la distinction entre combattants et civils, et la proportionnalité des attaques. Les algorithmes, même sophistiqués, peuvent manquer de discernement contextuel, conduisant à des violations involontaires. La transparence des systèmes d'IA est souvent limitée, ce qui complique encore l'attribution des responsabilités en cas d'incident.

Juridiquement, les cadres existants sont insuffisants pour faire face à ces nouveaux défis. Les conventions internationales, comme le Traité sur les armes autonomes létales, peinent à suivre le rythme des innovations technologiques. Sans une régulation stricte, la dilution des responsabilités pourrait devenir la norme, sapant la confiance dans les institutions militaires et augmentant les risques de conflits non contrôlés.

Vers des solutions pour préserver la responsabilité humaine

Pour atténuer ces risques, plusieurs pistes sont explorées par les chercheurs et les décideurs politiques. Premièrement, il est essentiel de maintenir un contrôle humain significatif sur les systèmes d'IA militaires, en veillant à ce que les décisions finales restent entre les mains de personnes formées et responsables. Deuxièmement, la transparence et l'auditabilité des algorithmes doivent être renforcées, permettant de retracer les actions et d'identifier les défaillances.

Enfin, une coopération internationale accrue est nécessaire pour établir des normes éthiques communes et des mécanismes de responsabilisation. Sans cela, la course à l'armement basé sur l'IA pourrait conduire à une escalade dangereuse, où la dilution des responsabilités deviendrait un facteur d'instabilité mondiale. L'avenir de la sécurité dépend de notre capacité à intégrer l'IA tout en préservant les principes fondamentaux de responsabilité humaine.