L'ultimatum de Washington rejeté par Anthropic

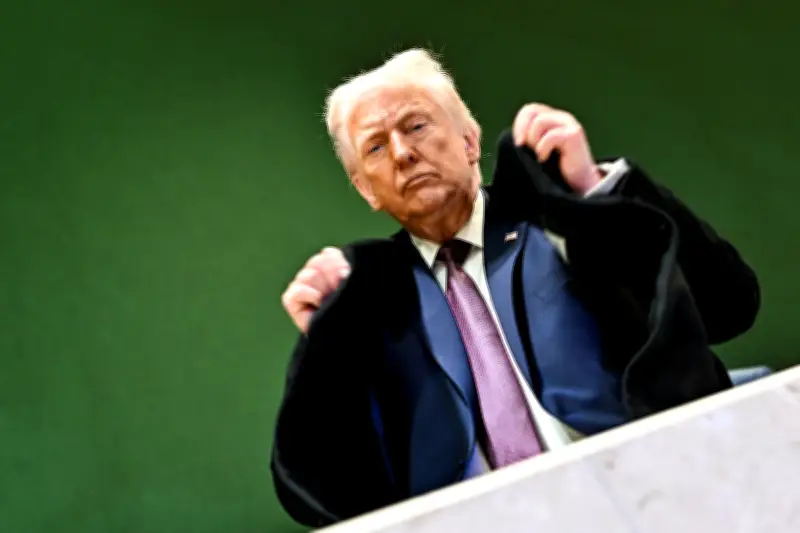

Anthropic n'a pas cédé à l'ultimatum de Washington. Donald Trump a donc ordonné, ce vendredi, « à TOUTES les agences fédérales du gouvernement américain de CESSER IMMÉDIATEMENT toute utilisation de la technologie d'Anthropic », dans la mesure où l'entreprise refuse d'octroyer un accès sans restriction de son intelligence artificielle à l'armée américaine.

« Nous n'en avons pas besoin, nous n'en voulons pas, et nous ne travaillerons plus avec eux », a fustigé le président américain sur son réseau Truth Social. Le ton est donné pour un conflit majeur entre le pouvoir exécutif américain et l'un des géants émergents de l'intelligence artificielle.

Une « leçon magistrale d'arrogance et de trahison »

Anthropic « a donné une leçon magistrale d'arrogance et de trahison », a renchéri sur X le ministre de la Défense, Pete Hegseth. « Leur véritable objectif est sans équivoque : s'arroger un pouvoir de veto sur les décisions opérationnelles de l'armée américaine. C'est inacceptable », s'est-il insurgé.

« Les soldats américains ne seront jamais pris en otage par les caprices idéologiques des géants de la tech », a-t-il ajouté avec une détermination sans faille. Le ministre a mis sa menace à exécution en ordonnant l'inscription d'Anthropic sur la liste des entreprises présentant « un risque pour les approvisionnements en termes de sécurité nationale ».

« Avec effet immédiat, aucun sous-traitant, fournisseur ou partenaire qui collabore avec l'armée américaine ne peut s'engager dans une quelconque activité commerciale avec Anthropic », a-t-il annoncé, durcissant considérablement la position américaine.

Claude, l'IA rebelle au cœur du conflit

Le conflit entre le ministère de la Guerre et Anthropic porte spécifiquement sur les conditions d'utilisation de sa technologie, notamment en matière de défense. Comme l'explique le New York Times, le Pentagone souhaite utiliser une version classifiée de son intelligence artificielle, baptisée Claude.

Mais la start-up californienne créée en 2021 par d'anciens membres d'OpenAI et évaluée aujourd'hui à environ 380 milliards de dollars, est connue pour valoriser la sécurité et l'éthique de l'IA. Bien qu'habituée à collaborer avec les agences de renseignement américaines, elle estime que même les systèmes d'IA les plus avancés ne sont pas encore fiables au point de leur confier les commandes d'armes mortelles.

Aussi veut-elle doter Claude d'un dispositif de sécurité empêchant son utilisation abusive à des fins de surveillance massive ou dans des armes autonomes sans intervention humaine. « Dans un nombre restreint de cas, nous pensons que l'IA peut nuire aux valeurs démocratiques, plutôt que les défendre », a déclaré Dario Amodei, le dirigeant d'Anthropic.

Des principes éthiques fermement défendus

« Utiliser ces systèmes à des fins de surveillance de masse domestique est incompatible avec les valeurs démocratiques », a-t-il estimé avec conviction. De plus, les armes autonomes « doivent être déployées avec des garde-fous appropriés, qui n'existent pas aujourd'hui (…) Nous ne fournirons pas sciemment un produit qui met militaires et civils américains en danger ».

Le Pentagone, qui assure n'avoir nullement l'intention d'utiliser Claude à ces fins, rappelle qu'un sous-traitant privé n'a de toute façon pas son mot à dire quant à l'utilisation légale de ses outils en matière de sécurité nationale. « Leur égoïsme met en danger des vies américaines, nos troupes et la sécurité nationale », a dénoncé Donald Trump, qualifiant la résistance d'Anthropic d'« erreur désastreuse ».

La Silicon Valley se mobilise en soutien

Mais l'inquiétude de la start-up, quant à un possible usage abusif de son intelligence artificielle, fait écho dans la Silicon Valley. Jeudi, une lettre ouverte a été mise en ligne par des employés d'OpenAI et Google pour soutenir la décision d'Anthropic et appeler leurs directions respectives à suivre son exemple en « refusant les demandes actuelles du ministère de la Guerre ».

« Le Pentagone négocie actuellement avec Google et OpenAI pour tenter de les convaincre d'accepter ce qu'Anthropic a refusé », dénoncent-ils dans cette missive intitulée « Nous ne serons pas divisés ». « Ils essaient de diviser chaque entreprise en craignant que l'autre ne cède. Cette stratégie ne fonctionne que si aucun d'entre nous ne connaît la position des autres. Cette lettre vise à créer une compréhension commune et une solidarité face à la pression exercée par le ministère de la Guerre ».

Jeff Dean, haut dirigeant très respecté de Google, figurant dans le classement du Time des 100 personnalités les plus influentes du secteur de l'IA en 2025, fait partie des 523 signataires – un nombre qui ne cesse de s'accroître jour après jour.

L'IA, nouvel enjeu de pouvoir mondial

« Un conflit comme celui-ci était inévitable », explique au New York Times Michael C. Horowitz, qui a travaillé sur les questions relatives à l'armement basé sur l'IA au sein du ministère de la Défense sous Biden. « La technologie évoluant si rapidement, nous avons aujourd'hui ces débats. L'IA est passée d'un sujet de conversation confidentiel à un élément véritablement central du pouvoir mondial », dont les limites d'usage font débat.

S'ils étaient plutôt alignés avec la politique technologique de Donald Trump en 2025, les géants de la tech commencent à rétropédaler face aux ambitions démesurées de Washington. La question éthique de l'utilisation militaire de l'intelligence artificielle devient ainsi un point de friction majeur entre l'administration américaine et l'industrie technologique, avec des implications potentielles considérables pour l'avenir de l'innovation et de la sécurité nationale.